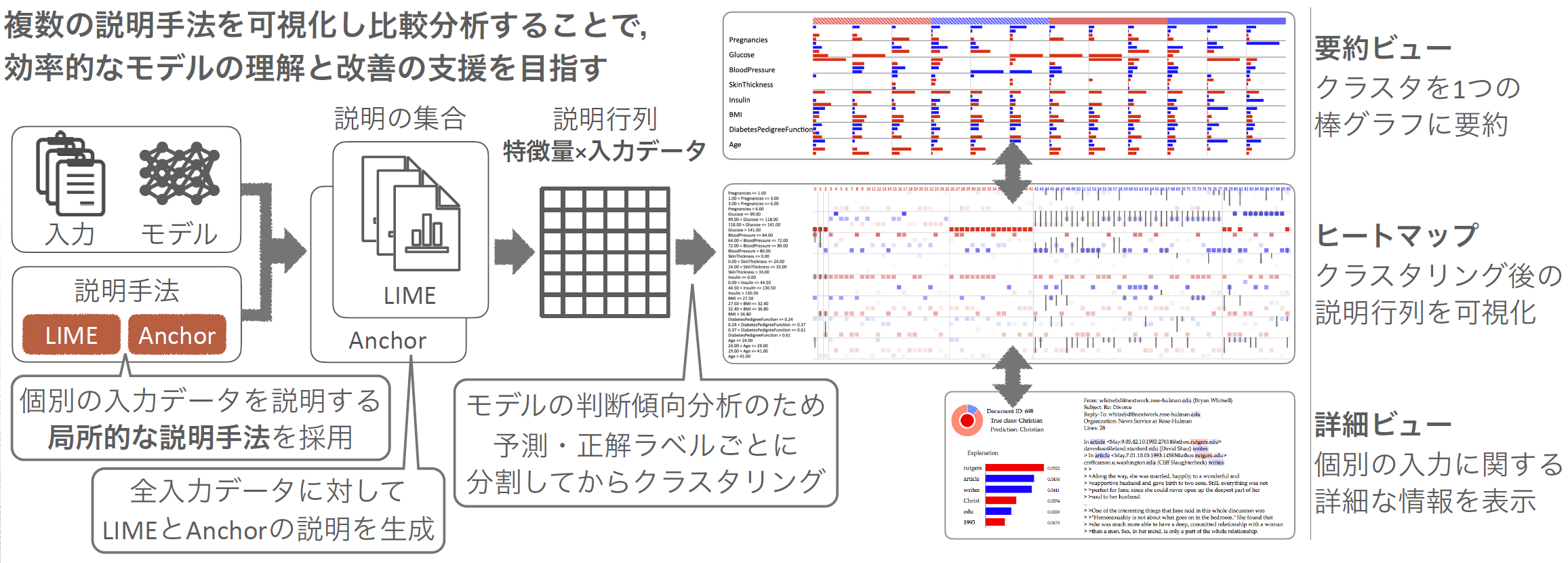

機械学習モデルはさまざまな分野で高い性能を発揮しており,実世界での利用も進んでいます.その一方で,特に医療や金融といった意思決定の影響が重大な分野では,モデルやその出力に対する透明性や解釈性が求められています.本研究では,個別の事例に説明を付与する局所的な説明手法を用いてモデルの解釈と改善を支援する可視化分析を提案しています.大量の入力データに対して局所的な説明を生成し,それをヒートマップや棒グラフの集合で可視化することで,多様な入力に対するモデルの挙動の分析が可能になります.このとき複数の説明手法を採用して可視

化することで,それぞれの手法により生成された説明を比較しながらモデルが学習した知識や予測根拠を理解することで,より効率的なモデル解釈・改善が実現することを目指しています.

研究成果

- 澤田頌子, 豊田正史. 複数の局所的説明の比較による分類モデル解釈支援のための可視化手法,2022年度 人工知能学会全国大会(第36回), 2022